"ransomware"

Python

Publicado el 12 de Abril del 2025 por Hilario (145 códigos)

635 visualizaciones desde el 12 de Abril del 2025

*****************************************************************************************

*****************************************************************************************

Aula_18_Abril_25_Ranson.py

**********************************

Con este ejercicio que traigo hoy, no pretendo, por supuesto, dar una enseñanza de cómo programar un programa del tipo: "ransomware". Dado que su complejo código se escapa a esta enseñanza. Con este programa hecho en Python, bajo plataforma Linux Ubuntu, hago un acercamiento a una simulación de cómo funcionaría un: "ransomware".

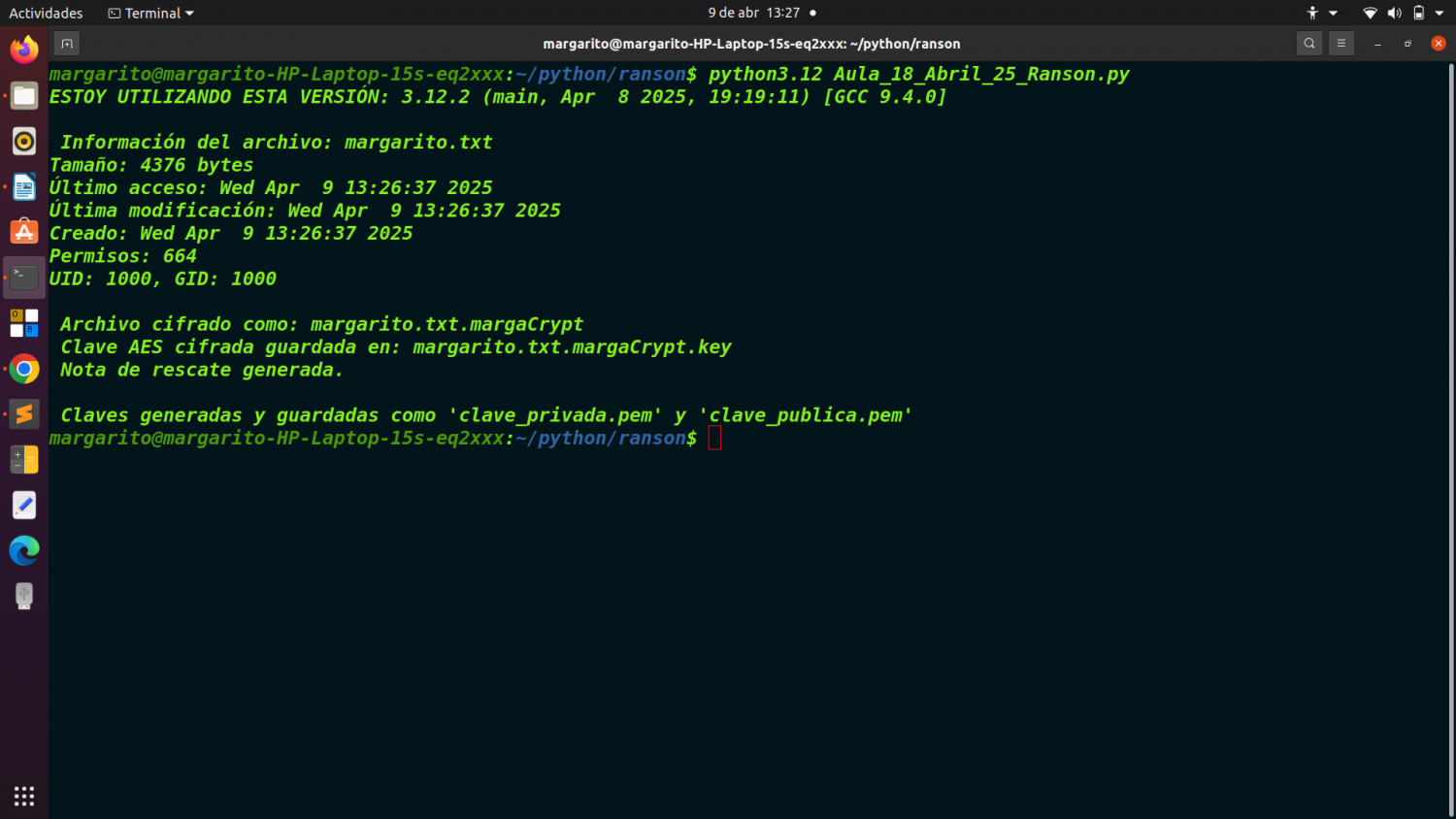

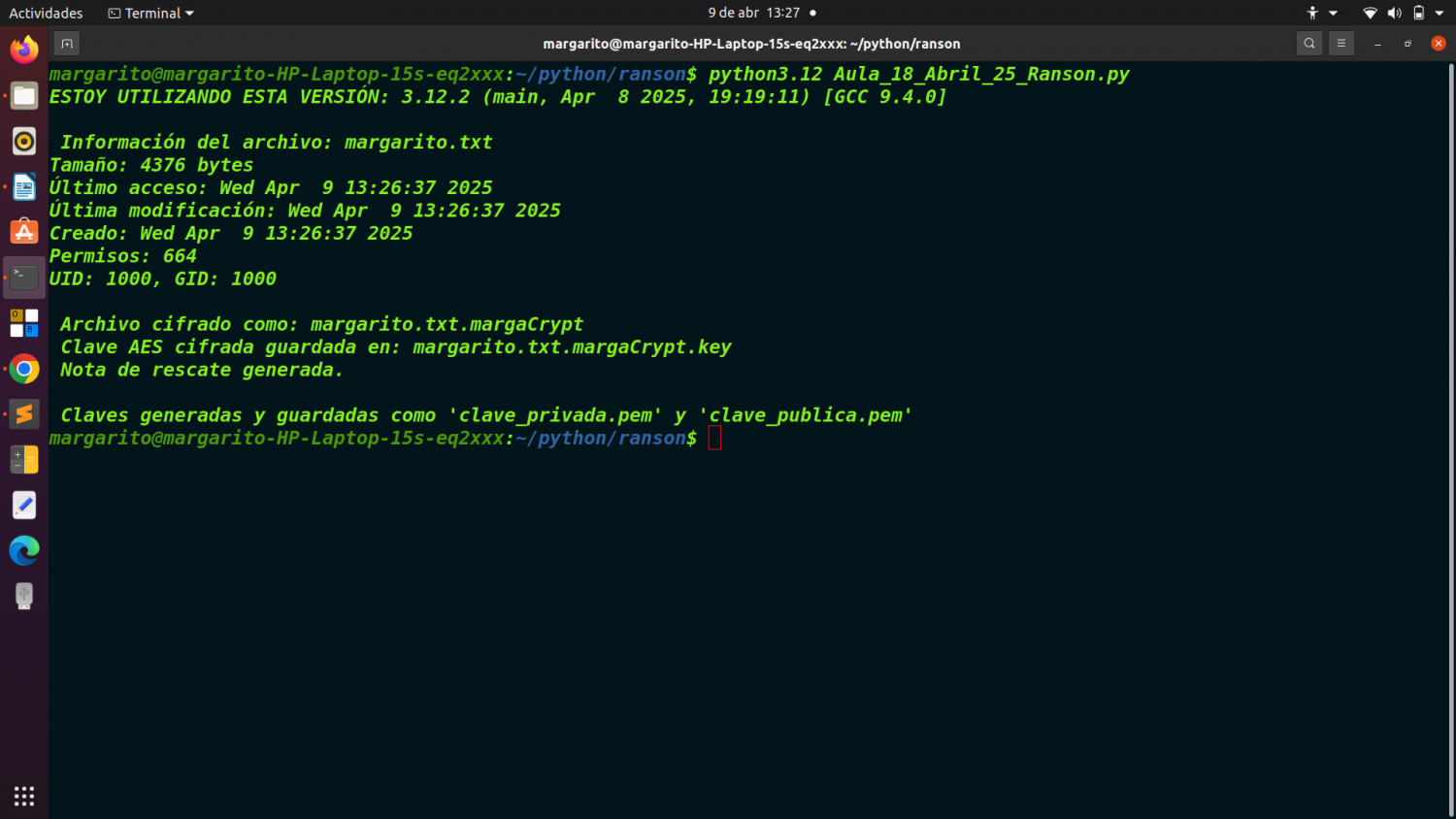

Para su funcionamiento se deberá crear un fichero, que quede alojado en el directorio actual, donde se ejecute: Aula_18_Abril_25_Ranson.py. En mi caso he creado con un texto cualquiera el fichero: margarito.txt.

En este programa no explicaré en un pequeño manual, como otras veces, sus caracteristicas y cada línea de código. Dado que es ligeramente más complejo. He preferido, explicarlo ampliamente en el propio código.

Creo, que en líneas generales, podrá ser interpretado con un poco de estudio. Tampoco os indico las importaciones necesarias, ya que el propio código indica con los import, los módulos necesarios para su funcionamiento, y que debereis tener cargados en vuestra versión de python para que no os de el error de falta de módulo. En mi casi la versión de python es la 3.12.2.

En la semana del 12 al 15 de Abril, haremos un estudio en nuestra clase. Donde explicaremos y debatiremos el código.

********************************************

La ejecución de este programa se realiza bajo consola de Linix, en mi caso: Ubuntu 20.04.6 LTS, con este comando:

python3.12 Aula_18_Abril_25_Ranson.py

La ejecución dependerá de la versión python que esteis utilizando.

Fue editado, en mi caso, con Sublime Text.

*****************************************************************************************

Aula_18_Abril_25_Ranson.py

**********************************

Con este ejercicio que traigo hoy, no pretendo, por supuesto, dar una enseñanza de cómo programar un programa del tipo: "ransomware". Dado que su complejo código se escapa a esta enseñanza. Con este programa hecho en Python, bajo plataforma Linux Ubuntu, hago un acercamiento a una simulación de cómo funcionaría un: "ransomware".

Para su funcionamiento se deberá crear un fichero, que quede alojado en el directorio actual, donde se ejecute: Aula_18_Abril_25_Ranson.py. En mi caso he creado con un texto cualquiera el fichero: margarito.txt.

En este programa no explicaré en un pequeño manual, como otras veces, sus caracteristicas y cada línea de código. Dado que es ligeramente más complejo. He preferido, explicarlo ampliamente en el propio código.

Creo, que en líneas generales, podrá ser interpretado con un poco de estudio. Tampoco os indico las importaciones necesarias, ya que el propio código indica con los import, los módulos necesarios para su funcionamiento, y que debereis tener cargados en vuestra versión de python para que no os de el error de falta de módulo. En mi casi la versión de python es la 3.12.2.

En la semana del 12 al 15 de Abril, haremos un estudio en nuestra clase. Donde explicaremos y debatiremos el código.

********************************************

La ejecución de este programa se realiza bajo consola de Linix, en mi caso: Ubuntu 20.04.6 LTS, con este comando:

python3.12 Aula_18_Abril_25_Ranson.py

La ejecución dependerá de la versión python que esteis utilizando.

Fue editado, en mi caso, con Sublime Text.