Publicado el 16 de Febrero del 2020

886 visualizaciones desde el 16 de Febrero del 2020

670,4 KB

3 paginas

Creado hace 16a (15/10/2008)

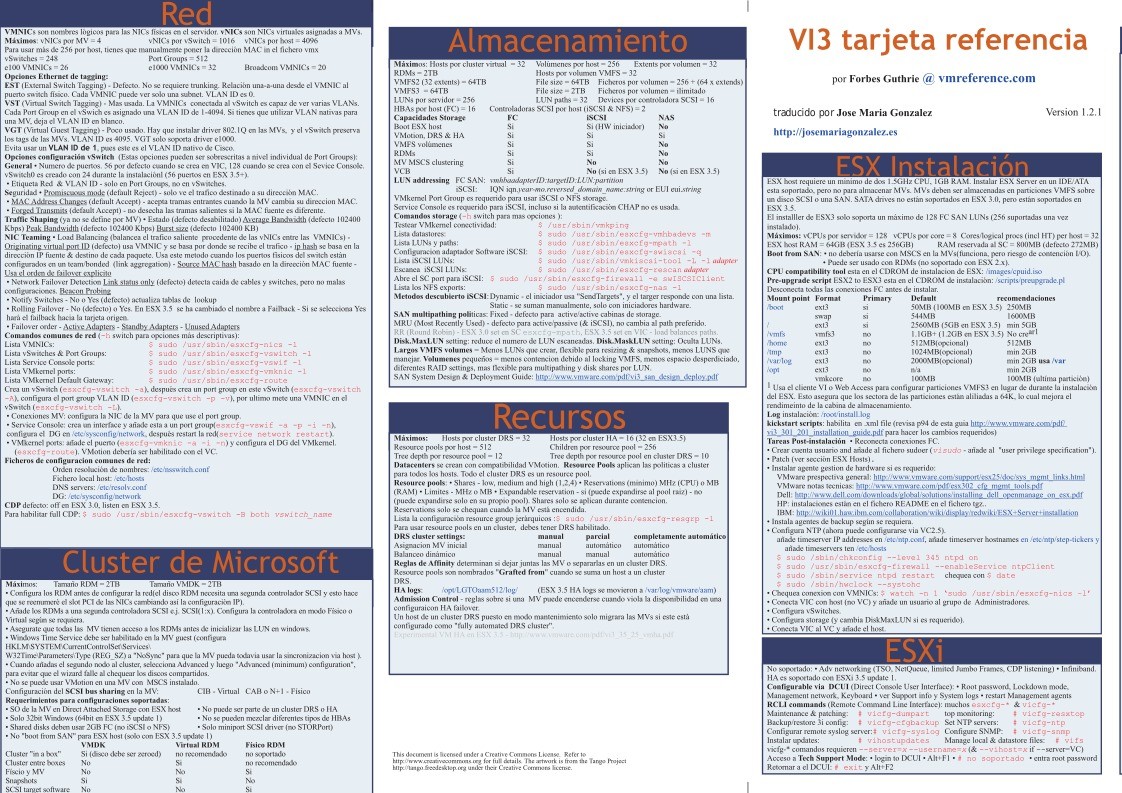

s son nombres lógicos para las NICs físicas en el servidor.

: vNICs por MV = 4

son NICs virtuales asignadas a MVs.

vNICs por host = 4096

Para usar más de 256 por host, tienes que manualmente poner la dirección MAC in el fichero vmx

vSwitches = 248

e100 VMNICs = 26

Port Groups = 512

e1000 VMNICs = 32

vNICs por vSwitch = 1016

Broadcom VMNICs = 20

(External Switch Tagging) - Defecto. No se requiere trunking. Relación una-a-una desde el VMNIC al

puerto switch físico. Cada VMNIC puede ver solo una subnet. VLAN ID es 0.

(Virtual Switch Tagging) - Mas usada. La VMNICs conectada al vSwitch es capaz de ver varias VLANs.

Cada Port Group en el vSwich es asignado una VLAN ID de 1-4094. Si tienes que utilizar VLAN nativas para

una MV, deja el VLAN ID en blanco.

(Virtual Guest Tagging) - Poco usado. Hay que instalar driver 802.1Q en las MVs, y el vSwitch preserva

los tags de las MVs. VLAN ID es 4095. VGT solo soporta driver e1000.

Evita usar un

, pues este es el VLAN ID nativo de Cisco.

• Numero de puertos. 56 por defecto cuando se crea en VIC, 128 cuando se crea con el Sevice Console.

(Estas opciones pueden ser sobrescritas a nivel individual de Port Groups):

vSwitch0 es creado con 24 durante la instalaciónl (56 puertos en ESX 3.5+).

• Etiqueta Red & VLAN ID - solo en Port Groups, no en vSwitches.

guridad • Promiscuous mode (default Reject) - solo ve el trafico destinado a su dirección MAC.

• MAC Address Changes (default Accept) - acepta tramas entrantes cuando la MV cambia su direccion MAC.

• Forged Transmits (default Accept) - no desecha las tramas salientes si la MAC fuente es diferente.

(ya no se define por MV) • Estado (defecto desabilitado) Average Bandwidth (defecto 102400

Kbps) Peak Bandwidth (defecto 102400 Kbps) Burst size (defecto 102400 KB)

• Load Balancing (balancea el trafico saliente procedente de las vNICs entre las VMNICs) -

Originating virtual port ID (defecto) usa VMNIC y se basa por donde se recibe el trafico - ip hash se basa en la

dirección IP fuente & destino de cada paquete. Usa este metodo cuando los puertos físicos del switch están

configurados en un team/bonded (link aggregation) - Source MAC hash basado en la direeción MAC fuente -

Usa el orden de failover explicito

• Network Failover Detection Link status only (defecto) detecta caida de cables y switches, pero no malas

configuraciones. Beacon Probing

• Notify Switches - No o Yes (defecto) actualiza tablas de lookup

• Rolling Failover - No (defecto) o Yes. En ESX 3.5 se ha cambiado el nombre a Failback - Si se selecciona Yes

hará el failback hacia la tarjeta origen.

• Failover order - Active Adapters - Standby Adapters - Unused Adapters

switch para opciones más descriptivas):

(

Lista VMNICs:

Lista vSwitches & Port Groups:

Lista Service Console ports:

Lista VMkernel ports:

Lista VMkernel Default Gateway:

Crea un vSwitch (

), después crea un port group en este vSwitch (

), por ultimo mete una VMNIC en el

), configura el port group VLAN ID (

).

vSwitch (

• Conexiones MV: configura la NIC de la MV para que use el port group.

• Service Console: crea un interface y añade esta a un port group(

configura el DG en /etc/sysconfig/network, después restart la red(

• VMkernel ports: añade el puerto (

(

). VMotion debería ser habilitado con el VC.

),

).

) y configura el DG del VMkernel.

Orden resolución de nombres: /etc/nsswitch.conf

Fichero local host: /etc/hosts

DNS servers: /etc/resolv.conf

DG: /etc/sysconfig/network

defecto: off en ESX 3.0, listen en ESX 3.5.

Para habilitar full CDP:

mos:

Tamaño RDM = 2TB

Tamaño VMDK = 2TB

• Configura los RDM antes de configurar la red(el disco RDM necesita una segunda controlador SCSI y esto hace

que se reenumeré el slot PCI de las NICs cambiando así la configuración IP).

• Añade los RDMs a una segunda controladora SCSI e.j. SCSI(1:x). Configura la controladora en modo Físico o

Virtual según se requiera.

• Asegurate que todas las MV tienen acceso a los RDMs antes de inicializar las LUN en windows.

• Windows Time Service debe ser habilitado en la MV guest (configura

HKLM\SYSTEM\CurrentControlSet\Services\

W32Time\Parameters\Type (REG_SZ) a "NoSync" para que la MV pueda todavia usar la sincronizacion via host ).

• Cuando añadas el segundo nodo al cluster, selecciona Advanced y luego "Advanced (minimum) configuration",

para evitar que el wizard falle al chequear los discos compartidos.

• No se puede usar VMotion en una MV con MSCS instalado.

Configuración del

CIB - Virtual CAB o N+1 - Físico

en la MV:

• SO de la MV en Direct Attached Storage con ESX host

• Solo 32bit Windows (64bit en ESX 3.5 update 1)

• Shared disks deben usar 2GB FC (no iSCSI o NFS)

• No "boot from SAN" para ESX host (solo con ESX 3.5 update 1)

• No puede ser parte de un cluster DRS o HA

• No se pueden mezclar diferentes tipos de HBAs

• Solo miniport SCSI driver (no STORPort)

:

Hosts por cluster DRS = 32 Hosts por cluster HA = 16 (32 en ESX3.5)

Resource pools por host = 512

Tree depth por resource pool = 12

se crean con compatibilidad VMotion.

para todos los hosts. Todo el cluster DRS es un resource pool.

Children por resource pool = 256

Tree depth por resource pool en cluster DRS = 10

aplican las politicas a cluster

: • Shares - low, medium and high (1,2,4) • Reservations (minimo) MHz (CPU) o MB

(RAM) • Limites - MHz o MB • Expandable reservation - si (puede expandirse al pool raiz) - no

(puede expandirse solo en su propio pool). Shares solo se aplican durante contencion.

Reservations solo se chequan cuando la MV está encendida.

Lista la configuración resource group jerárquicos :

Para usar resource pools en un cluster, debes tener DRS habilitado.

Asignacion MV inicial

Balanceo dinámico

automático

automático

determinan si dejar juntas las MV o separarlas en un cluster DRS.

" cuando se suma un host a un cluster

automático

manual

manual

manual

Resource pools son nombrados "

DRS.

:

/opt/LGTOaam512/log/

(ESX 3.5 HA logs se movieron a /var/log/vmware/aam)

- reglas sobre si una MV puede encenderse cuando viola la disponibilidad en una

configuraicon HA failover.

Un host de un cluster DRS puesto en modo mantenimiento solo migrara las MVs si este está

configurado como "fully automated DRS cluster".

Experimental VM HA en ESX 3.5 - http://www.vmware.com/pdf/vi3_35_25_vmha.pdf

ESX host requiere un minimo de dos 1.5GHz CPU, 1GB RAM. Instalar ESX Server en un IDE/ATA

esta soportado, pero no para almacenar MVs. MVs deben ser almacenadas en particiones VMFS sobre

un disco SCSI o una SAN. SATA drives no están soportados en ESX 3.0, pero están soportados en

ESX 3.5.

El installler de ESX3 solo soporta un máximo de 128 FC SAN LUNs (256 suportadas una vez

instalado).

vCPUs por servidor = 128 vCPUs por core = 8 Cores/logical procs (incl HT) per host = 32

ESX host RAM = 64GB (ESX 3.5 es 256GB) RAM reservada al SC = 800MB (defecto 272MB)

: • no debería usarse con MSCS en la MVs(funciona, pero riesgo de contención I/O).

• Puede ser usado con RDMs (no soportado con ESX 2.x).

esta en el CDROM de instalacion de ESX: /images/cpuid.iso

ESX2 to ESX3 esta en el CDROM de instalación: /scripts/preupgrade.pl

Desconecta todas las conexiones FC antes de instalar.

/boot

ext3

swap

ext3

vmfs3

ext3

ext3

ext3

ext3

vmkcore

/

/vmfs

/home

/tmp

/var/log

/opt

1 Usa el cliente VI o Web Access para configurar particiones VMFS3 en lugar de durante la instalación

del ESX. Esto asegura que los sectora de las particiones están aliliadas a 64K, lo cual mejora el

rendimeinto de la cabina de almacenamiento.

50MB (100MB en ESX 3.5) 250MB

544MB

1600MB

2560MB (5GB en ESX 3.5) min 5GB

1.1GB+ (1.2GB en ESX 3.5) No crear1

512MB(opcional)

1024MB(opcional)

2000MB(opcional)

n/a

100MB

512MB

min 2GB

min 2GB

min 2GB

100MB (ultíma partición)

si

si

si

no

no

no

no

no

no

instalación: /root/install.log

vi3_301_201_installation_guide.pdf para hacer los cambios requeridos)

: habilita en .xml file (revisa p94 de esta guia http://www.vmware.com/pdf/

• Reconecta conexiones FC.

- añade al "user privilege specification").

• Crear cuenta usuario and añade al fichero sudoer (

• Patch (ver sección ESX Hosts)

• Instalar agente gestion de hardware si es requerido:

VMware prespectiva general: http://www.vmware.com/support/esx25/doc/sys_mgmt_links.html

VMware notas tecnicas: http://www.vmware.com/pdf/esx302_cfg_mgmt_tools.pdf

Dell: http://www.dell.com/downloads/global/solutions/installing_dell_openmanage_on_esx.pdf

HP: instalaciones están en el fichero README en el fichero tgz..

IBM: http://wiki01.haw.ibm.com/collaboration/wiki/display/redwiki/ESX+Server+installation

• Instala agentes de backup según se requiera.

• Configura NTP (ahora puede configurarse via VC2.5).

añade timeserver IP addresses en /etc/ntp.conf, añade timeserver hostnames en /etc/ntp/step-tickers y

añade timeservers ten /etc/hosts

chequea con

• Chequea conexion con VMNICs:

• Conecta VIC con host (no VC) y añade un usuario al grupo de Administradores.

• Configura vSwitches.

• Configura storage (y cambia DiskMaxLUN si es requerido).

• Conecta VIC al VC y añade el host.

No soportado: • Adv networking (TSO, NetQueue, limited Jumbo Frames, CDP listening) • Infiniband.

HA es soportado con ESXi 3.5 update 1.

(Direct Console User Interface): • Root password, Lockdown mode,

Management network, Keyboard • ver Support info y System logs • restart Management agents

(Remote Command Line Interface): muchos

&

Maintenance & patching:

Backup/restore 3i config:

Configurar remote syslog server:

Instalar updates:

vicfg-* comandos requieren

Acceso a

Retornar a el DCUI:

top monitoring:

Set NTP servers:

Configure SNMP:

Manage local & datastore files:

(&

: • login to DCUI • Alt+F1 •

y Alt+F2

server=VC)

if

• entra root password

os: Hosts por cluster virtual = 32 Volúmenes por host = 2

Crear cuenta

Crear cuenta

Comentarios de: VI3 Reference Card (0)

No hay comentarios