Base de datos sqlite.

Python

Publicado el 16 de Diciembre del 2024 por Hilario (145 códigos)

1.365 visualizaciones desde el 16 de Diciembre del 2024

************************************************////*******************************************

Aula_28_Diciembre_15_sql.py

**********************************

Programa realizado bajo paltaforma Linux, concretamente con Ubuntu 20.04.6 LTS.

Editado con Sublime text

#Ejecución.

#Bajo consola linux.

python3 Aula_28_Diciembre_15_sql.py

Alumnos, para entender mejor este ejercicio, inicialmente vamos a instalar el programa para Linux: DB Browser for SQLite

------------------------------------------//--------------------------------

Utilizaremos este comando por consola de linux, en mi caso utilizo Ubuntu.

sudo apt install sqlitebrowser

***************************************************************************************************

Vamos a realizar un ejercicio en Python, con el fin de relacionar un programa orientado a base de datos, para ir cargandolos secuencialmente en nuestra base datos y poder ver bajo genome, con el programa DB Browser for SQLite, los resultados.

Creo que es lo más sencillo que podemos hacer, queridos alumnos, para aprender sobre este importante tema, las bases SQL.

Bien, vamos a ver un poco este ejercicio.

Explicación General del Ejercicio: Aula_28_Diciembre_15_sql.py

Clase del 18 de Diciembre - Aula 28 (Mañana)

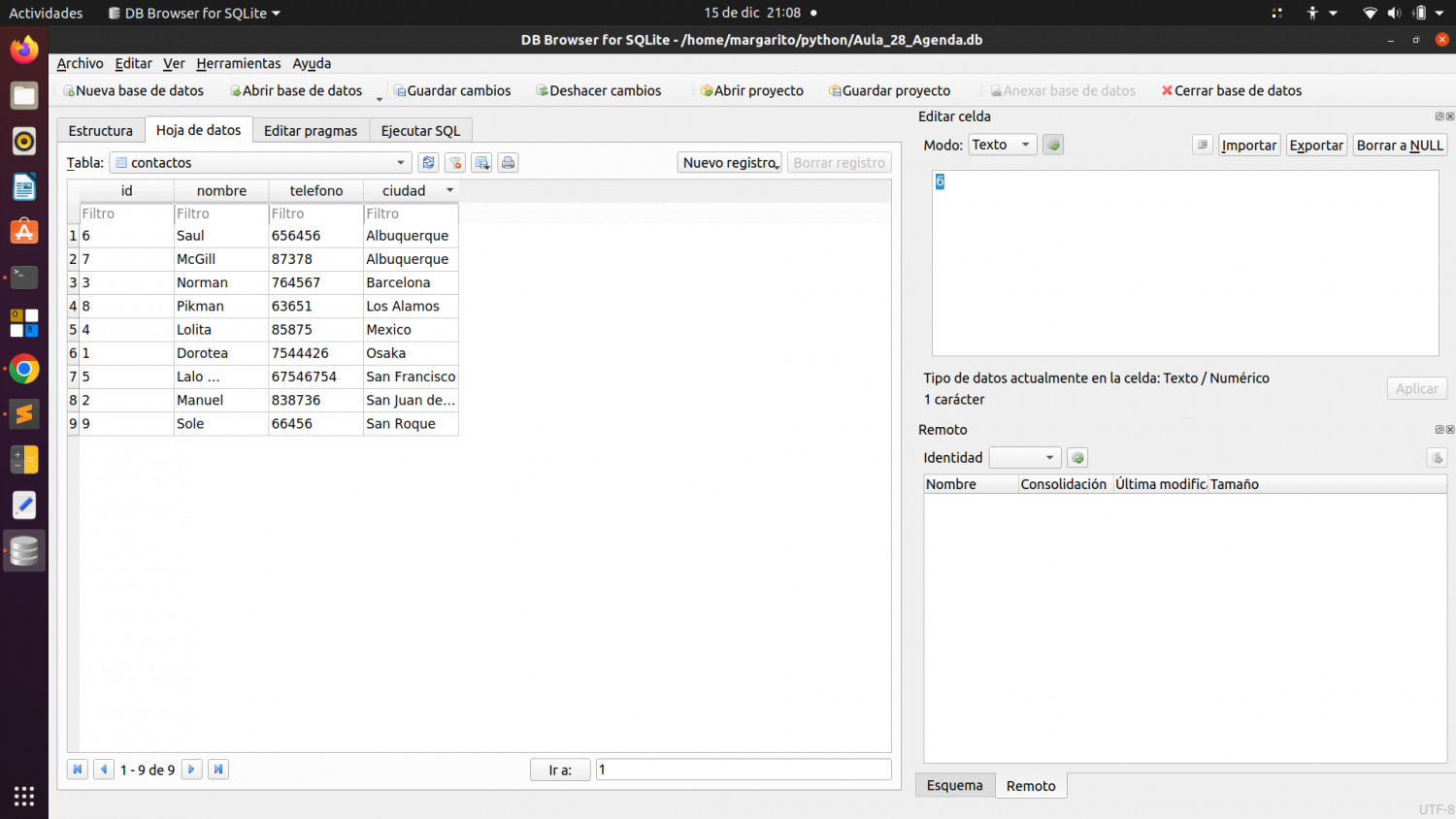

Este ejercicio tiene como objetivo enseñar a los alumnos cómo crear, gestionar y manipular una base de datos utilizando SQLite en Python. Se presenta una agenda de contactos como ejemplo práctico, con funcionalidades para agregar, buscar, eliminar y listar contactos. El archivo generado se llama Aula_28_Agenda.db y será almacenado localmente.

Conceptos Clave:

SQLite:

Es un sistema de gestión de bases de datos ligero y sin servidor. No requiere configuración previa, lo que lo hace ideal para proyectos pequeños o educativos.

Base de datos:

Un lugar donde almacenamos datos organizados en tablas. En este caso, tenemos una tabla llamada contactos que almacena:

id: Identificador único (autoincremental).

nombre: Nombre del contacto.

telefono: Número de teléfono.

ciudad: Ciudad del contacto.

Python y SQL:

Python se conecta con SQLite usando la biblioteca sqlite3. Los comandos SQL (CREATE, INSERT, SELECT, DELETE) nos permiten manipular los datos.

Estructura del Programa:

1. Inicialización de la Base de Datos:

La función inicializar_db() crea el archivo Aula_28_Agenda.db si no existe.

Dentro de este archivo, se define la tabla contactos con sus columnas (id, nombre, telefono, ciudad).

Se utiliza SQL para asegurar que la tabla se cree solo si no existe previamente.

Código relevante:

CREATE TABLE IF NOT EXISTS contactos (

id INTEGER PRIMARY KEY AUTOINCREMENT,

nombre TEXT NOT NULL,

telefono TEXT NOT NULL,

ciudad TEXT NOT NULL

)

2. Agregar Contactos

La función agregar_contacto(nombre, telefono, ciudad) permite al usuario añadir contactos a la base de datos.

Se utiliza una consulta SQL INSERT para insertar los datos proporcionados por el usuario.

INSERT INTO contactos (nombre, telefono, ciudad) VALUES (?, ?, ?)

3. Buscar Contactos

La función buscar_contacto(nombre) permite buscar contactos en la base de datos que coincidan parcialmente con un nombre.

Utiliza SELECT con una condición LIKE para encontrar coincidencias.

SELECT nombre, telefono, ciudad FROM contactos WHERE nombre LIKE ?

4. Eliminar Contactos

La función eliminar_contacto(nombre) elimina todos los contactos cuyo nombre coincida con el criterio de búsqueda.

Utiliza DELETE para borrar los registros encontrados.

DELETE FROM contactos WHERE nombre LIKE ?

5. Mostrar Todos los Contactos

La función mostrar_agenda() lista todos los contactos almacenados en la base de datos.

Utiliza SELECT para recuperar toda la información de la tabla contactos.

SELECT nombre, telefono, ciudad FROM contactos

Interacción con el Usuario

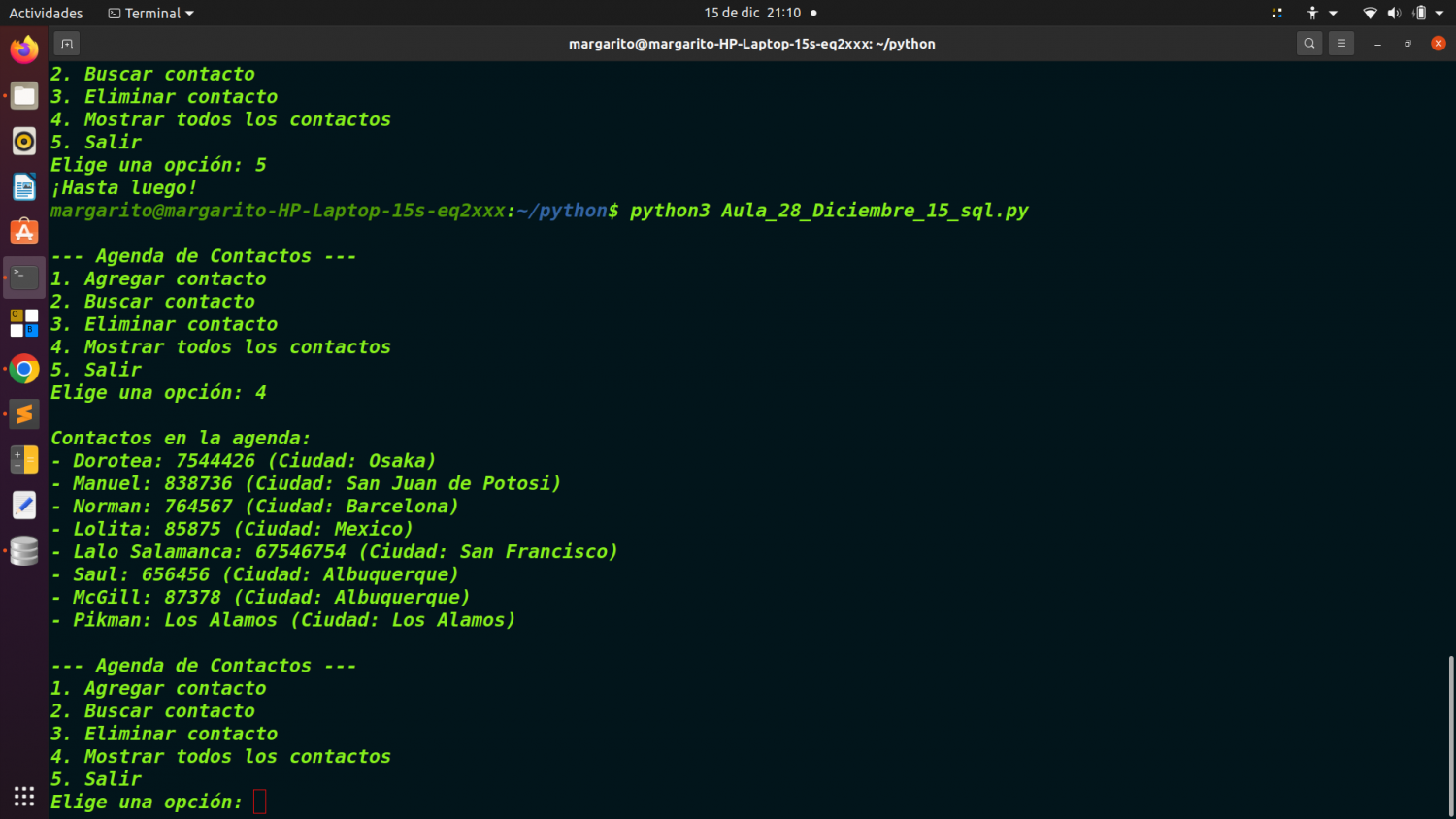

El programa incluye un menú interactivo que guía al usuario por las diferentes funcionalidades de la agenda.

Este menú permite:

Opción 1: Agregar un contacto.

Opción 2: Buscar un contacto.

Opción 3: Eliminar un contacto.

Opción 4: Mostrar todos los contactos.

Opción 5: Salir del programa.

El menú se ejecuta dentro de un bucle while hasta que el usuario elige salir.

Ejemplo Práctico

Al ejecutar el programa, se crea el archivo Aula_28_Agenda.db.

Desde el menú:

Seleccionas 1. Agregar contacto, introduces Juan, 123456789 y Madrid.

Seleccionas 2. Buscar contacto, introduces Juan y ves los detalles de ese contacto.

Seleccionas 3. Eliminar contacto, introduces Juan y confirmas que se ha eliminado.

Seleccionas 4. Mostrar todos los contactos, y verificas que no hay contactos.

Objetivos de Aprendizaje

Comprender cómo funcionan las bases de datos relacionales.

Conectar y manipular bases de datos SQLite desde Python.

Implementar operaciones básicas de bases de datos:

Crear tablas (CREATE).

Insertar datos (INSERT).

Leer datos (SELECT).

Eliminar datos (DELETE).

Desarrollar un programa estructurado y modular.

-----------------------------------------------------------------------------------------------------

Conclusión

Este ejercicio combina teoría y práctica para ayudar a los alumnos del Aula 28 a entender el manejo de bases de datos desde Python. Los conceptos aprendidos pueden ser aplicados en proyectos más complejos en el futuro.